Data Engineering 플레이북 — Part 7: DataOps & 팀 운영 플레이북 (시리즈 완결)

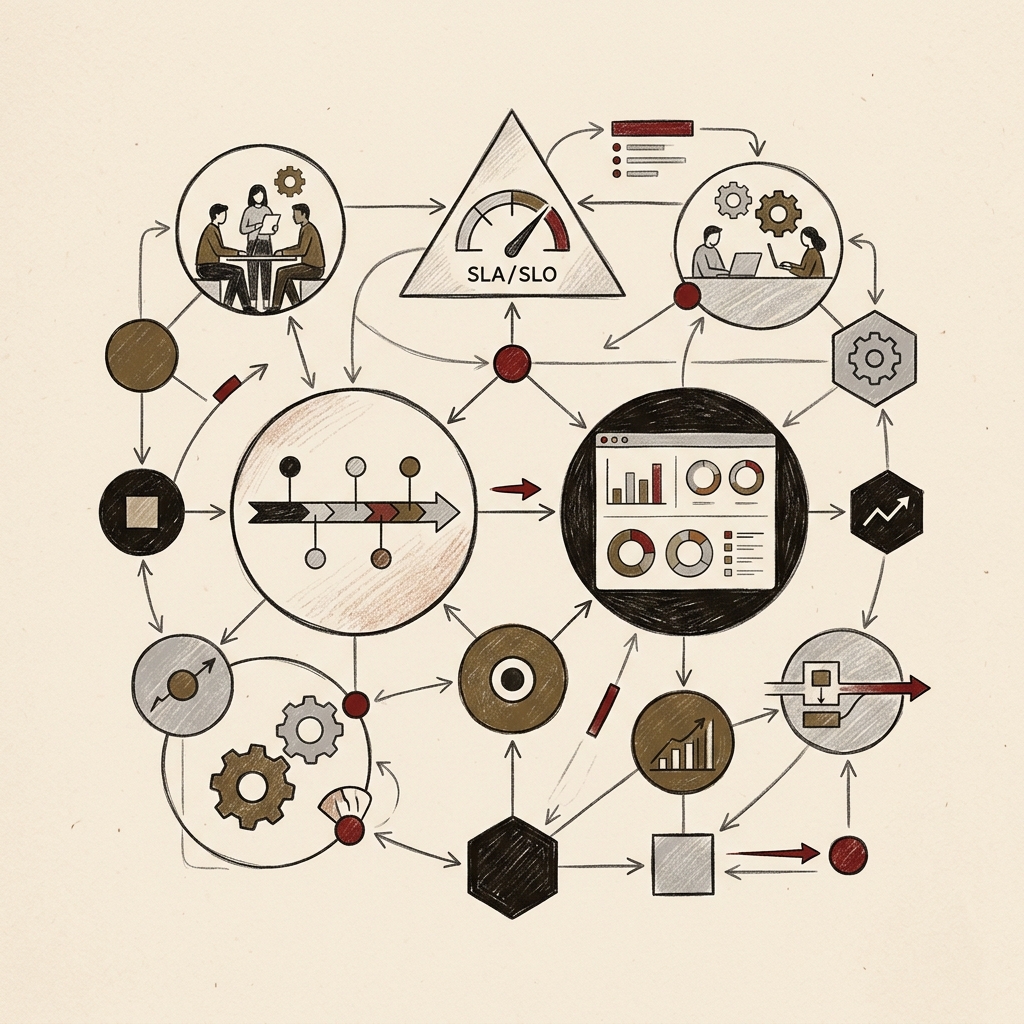

파이프라인을 신뢰할 수 있는 데이터 제품으로 운영하려면 DataOps 문화와 팀 운영 체계가 필요하다. DataOps 5대 원칙과 CI/CD 자동화, 팀 규모별 구조 설계, SLA/SLO/SLI·에러 버짓으로 신뢰성 정량화, 온콜·런북·포스트모템으로 장애 대응 시스템화, WAP 패턴으로 안전한 데이터 발행을 구현하는 실전 가이드. 7파트 시리즈 완결편.

시리즈 구성

- Part 1 — 개요 & 2026 핵심 트렌드 (완료)

- Part 2 — 데이터 아키텍처 설계 (완료)

- Part 3 — 데이터 파이프라인 구축 실전 가이드 (완료)

- Part 4 — 데이터 품질 & 거버넌스 (완료)

- Part 5 — 클라우드 & 인프라 (FinOps, IaC) (완료)

- Part 6 — AI-Native 데이터 엔지니어링 (완료)

- Part 7 — DataOps & 팀 운영 플레이북 (현재 편 · 완결)

목차

- DataOps — 파이프라인을 제품처럼 운영하기

- 데이터 팀 구조 설계

- 데이터 SLA / SLO / SLI 프레임워크

- 온콜(On-Call) 운영 플레이북

- 런북(Runbook) 작성 가이드

- Write-Audit-Publish (WAP) 패턴

- 데이터 엔지니어 커리어 패스 & 역량 로드맵

- 2026-2028 미래 전망

- 플레이북 전체 요약 — 내 팀을 위한 우선순위 결정법

1. DataOps — 파이프라인을 제품처럼 운영하기

DataOps란 무엇인가?

DataOps는 DevOps의 원칙을 데이터 세계에 적용한 운영 철학이다. 데이터 엔지니어, 데이터 사이언티스트, 분석가, 비즈니스 이해관계자가 사일로 없이 협력하고, 파이프라인을 코드처럼 버전 관리하며, 자동화로 품질과 속도를 동시에 확보하는 방식이다.

핵심 메시지는 하나다: "데이터 파이프라인을 ad-hoc 스크립트가 아닌, 신뢰할 수 있는 제품(Product)으로 운영하라."

DataOps 문화를 수용한 조직은 자동화와 재사용을 통해 운영 오버헤드를 20-25% 낮추는 성과를 거뒀다. 데이터 엔지니어들은 파이프라인 배관공이 아니라 아키텍처와 전략에 영향을 미치는 '플랫폼 스튜어드'로 성장한다.

DataOps의 5대 원칙

DataOps 성숙도 모델

Level 0 — 혼돈 (Chaos)

- 파이프라인이 스크립트 모음. 누가 무엇을 소유하는지 모름.

- 장애 시 범인 찾기에 시간 낭비. 문서 없음.

Level 1 — 반복 가능 (Repeatable)

- Git에 파이프라인 코드 저장.

- 기본 테스트와 알림 존재. 온콜 로테이션 시작.

Level 2 — 정의됨 (Defined)

- CI/CD 자동화. 데이터 계약 적용 시작.

- SLA 정의. 데이터 카탈로그 구축.

Level 3 — 관리됨 (Managed)

- 전 파이프라인 품질 SLA 모니터링.

- 비용 귀속 구현. 자동화된 드리프트 탐지.

- 런북 완비. 포스트모템 문화 정착.

Level 4 — 최적화됨 (Optimizing)

- AI 기반 이상 탐지. 에이전틱 셀프힐링 시작.

- 데이터 제품 단위 운영. 전사 데이터 리터러시 확산.

DataOps CI/CD — 데이터 파이프라인 배포 자동화

# .github/workflows/dataops_pipeline.yml

# 데이터 파이프라인 CI/CD 완전 자동화

name: DataOps Pipeline CI/CD

on:

pull_request:

paths: ['models/**', 'tests/**', 'pipelines/**']

push:

branches: [main]

jobs:

# 1단계: 코드 품질 검사

lint_and_format:

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v4

- name: SQL 포맷 검사 (sqlfluff)

run: sqlfluff lint models/ --dialect snowflake

- name: Python 린트 (ruff)

run: ruff check pipelines/

# 2단계: dbt 모델 테스트

dbt_test:

needs: lint_and_format

runs-on: ubuntu-latest

steps:

- name: dbt 빌드 & 테스트 (CI 전용 스키마)

run: |

dbt deps

dbt build --target ci \

--select state:modified+ \

--defer

env:

DBT_SNOWFLAKE_ACCOUNT: ${{ secrets.DBT_SNOWFLAKE_ACCOUNT }}

- name: 데이터 계약 검증

run: python scripts/validate_contracts.py --changed-models

# 3단계: 통합 테스트

integration_test:

needs: dbt_test

runs-on: ubuntu-latest

if: github.event_name == 'pull_request'

steps:

- name: 품질 게이트 체크 (Great Expectations)

run: great_expectations checkpoint run nightly_quality_check

# 4단계: 프로덕션 배포

deploy_production:

needs: [dbt_test, integration_test]

runs-on: ubuntu-latest

if: github.ref == 'refs/heads/main'

environment: production

steps:

- name: dbt 프로덕션 배포

run: dbt run --target prod --select state:modified+

- name: 배포 완료 알림 (Slack)

run: |

curl -X POST ${{ secrets.SLACK_WEBHOOK }} \

-d '{"text":"데이터 파이프라인 배포 완료: ${{ github.event.head_commit.message }}"}'

2. 데이터 팀 구조 설계

팀 규모별 구조 진화

팀의 크기는 어떤 조직 구조가 효과적인지를 결정한다. 정답은 없고, 현재 팀 규모와 성숙도에 맞는 구조가 가장 좋은 구조다.

소규모 팀 (1-5명) — 풀스택 데이터 엔지니어

[데이터 엔지니어 (1-3명)]

- 수집 + 변환 + 파이프라인 + 인프라 모두 담당

- 도구: dbt + Airflow + 단일 클라우드 (Snowflake or BigQuery)

- 우선순위: 빠른 가치 전달 > 완벽한 아키텍처

중간 규모 팀 (5-20명) — 역할 분화 시작

[데이터 플랫폼 엔지니어 (2-4명)]

- 인프라, IaC, 공통 플랫폼 컴포넌트 담당

[Analytics 엔지니어 (2-4명)]

- dbt 모델링, BI 연계, 비즈니스 로직 구현

[데이터 엔지니어 (2-4명)]

- 수집 파이프라인, 스트리밍, 배치 ETL

[ML 엔지니어 / MLOps (1-2명)]

- Feature Store, 모델 서빙 파이프라인

대규모 팀 (20명 이상) — 도메인 기반 분산

[중앙 데이터 플랫폼 팀] — 공통 인프라, 거버넌스

- Platform Engineer, DataGovOps, FinOps

[도메인 팀별 임베디드 데이터 엔지니어]

- 커머스 도메인: 주문/결제 파이프라인

- 마케팅 도메인: 캠페인/퍼널 파이프라인

- ML 플랫폼 팀: Feature Store, 모델 파이프라인

핵심 역할 정의

| 역할 | 핵심 책임 | 필수 기술 |

|---|---|---|

| 데이터 엔지니어 | 파이프라인 설계·구축·운영 | Python, SQL, Spark, Airflow |

| Analytics 엔지니어 | dbt 변환, 비즈니스 메트릭 정의 | SQL, dbt, 비즈니스 도메인 이해 |

| 데이터 플랫폼 엔지니어 | 공통 인프라, IaC, 플랫폼 컴포넌트 | Terraform, Kubernetes, 클라우드 |

| MLOps 엔지니어 | ML 파이프라인, Feature Store, 모델 서빙 | Python, MLflow, Kubernetes |

| 데이터 아키텍트 | 전사 데이터 아키텍처 설계·표준화 | 폭넓은 기술 역량 + 비즈니스 관점 |

온보딩 — 새 팀원이 30일 안에 생산적이 되려면

Week 1: 환경 이해

- 클라우드 계정, 도구 접근 권한 설정

- 주요 파이프라인 DAG 1개 완전히 이해

- 런북 1개 읽기

- 데이터 카탈로그 탐색

Week 2: 작은 기여

- 기존 파이프라인에 dbt 테스트 1개 추가

- 데이터 계약 1개 작성

- 온콜 팀원과 쉐도우 1회

Week 3-4: 독립 작업

- 중간 복잡도 파이프라인 1개 독립 구현

- PR 리뷰 2-3회

- 런북 1개 작성 기여

3. 데이터 SLA / SLO / SLI 프레임워크

세 개념의 관계

이 세 개념은 계층 구조를 이룬다. SLI를 측정하고, SLO를 내부 목표로 설정하며, SLA를 고객·이해관계자에게 약속한다. SLO는 SLA보다 높게 유지해야 한다 — 이 차이가 에러 버짓이다.

데이터 파이프라인 SLI 항목

# sli_definitions.py

# 데이터 파이프라인 SLI 정의 및 측정 자동화

from dataclasses import dataclass

from typing import Callable

@dataclass

class DataSLI:

name: str

description: str

unit: str

measurement_fn: Callable

owner: str

# 신선도 (Freshness)

freshness_sli = DataSLI(

name="data_freshness_hours",

description="마지막 성공 갱신 이후 경과 시간",

unit="hours",

measurement_fn=lambda table: measure_freshness(table),

owner="data-platform@company.com"

)

# 완전성 (Completeness)

completeness_sli = DataSLI(

name="completeness_rate_pct",

description="필수 컬럼 NULL이 아닌 비율",

unit="percent",

measurement_fn=lambda table: measure_completeness(table),

owner="data-platform@company.com"

)

# 볼륨 정상성 (Volume Normality)

volume_sli = DataSLI(

name="daily_row_volume_zscore",

description="7일 평균 대비 오늘 행 수의 Z-score",

unit="z-score",

measurement_fn=lambda table: measure_volume_anomaly(table),

owner="data-platform@company.com"

)

# 파이프라인 성공률 (Pipeline Success Rate)

pipeline_sli = DataSLI(

name="pipeline_success_rate_7d",

description="최근 7일 파이프라인 실행 성공 비율",

unit="percent",

measurement_fn=lambda dag_id: measure_pipeline_success(dag_id),

owner="data-platform@company.com"

)

SLO 정의 예시 — Tier별

# slo_definitions.yaml

slos:

# Tier 1: 비즈니스 크리티컬 (KPI, 재무, AI 학습 데이터)

- name: "fct_daily_revenue"

tier: 1

freshness:

slo: "< 2시간"

sla: "< 4시간"

completeness:

slo: "> 99.9%"

sla: "> 99.5%"

volume_anomaly:

slo: "Z-score < 3"

sla: "Z-score < 4"

pipeline_success_rate:

slo: "> 99.5% (7일 기준)"

sla: "> 99.0% (30일 기준)"

error_budget_monthly: "0.5% = 3.6시간/월"

on_call_severity: "P1 — 즉시 대응"

# Tier 2: 운영 분석 (마케팅, 운영 대시보드)

- name: "marketing_attribution"

tier: 2

freshness:

slo: "< 8시간"

sla: "< 12시간"

pipeline_success_rate:

slo: "> 99.0%"

sla: "> 98.0%"

on_call_severity: "P2 — 근무 시간 내 대응"

# Tier 3: 탐색적 분석

- name: "raw_event_logs"

tier: 3

freshness:

slo: "< 24시간"

sla: "< 48시간"

on_call_severity: "P3 — 다음 영업일 대응"

에러 버짓 계산기

def calculate_error_budget(slo_percent: float, period_days: int = 30) -> dict:

"""

SLO 기반 에러 버짓 계산.

예: SLO 99.5%, 30일 -> 에러 버짓 = 3.6시간/월

"""

error_budget_pct = 100 - slo_percent

total_minutes = period_days * 24 * 60

error_budget_minutes = total_minutes * (error_budget_pct / 100)

return {

"slo_percent": slo_percent,

"error_budget_percent": round(error_budget_pct, 3),

"error_budget_minutes": round(error_budget_minutes, 1),

"error_budget_hours": round(error_budget_minutes / 60, 2),

"period_days": period_days

}

# SLO 99.9%, 30일 -> 에러 버짓 0.72시간

print(calculate_error_budget(99.9, 30))

# {'slo_percent': 99.9, 'error_budget_percent': 0.1,

# 'error_budget_minutes': 43.2, 'error_budget_hours': 0.72, 'period_days': 30}

# SLO 99.5%, 30일 -> 에러 버짓 3.6시간

print(calculate_error_budget(99.5, 30))

# {'error_budget_hours': 3.6, ...}

4. 온콜(On-Call) 운영 플레이북

온콜이란?

온콜(On-Call)은 데이터 파이프라인 장애를 24시간 감시하고 즉시 대응하는 당직 제도다. SRE(Site Reliability Engineering) 문화에서 차용했으며, 데이터 플랫폼의 신뢰성 확보에 필수다.

온콜은 엔지니어를 혹사하는 제도가 아니다. 잘 설계된 온콜은 팀 전체가 시스템을 더 깊이 이해하고, 더 탄탄한 파이프라인을 만들도록 자연스럽게 유도한다.

온콜 설계 원칙

① 로테이션: 주 1회 이상 같은 사람이 온콜하지 않는다

→ 번아웃 방지, 지식 공유 촉진

② 에스컬레이션 계층: 1차 → 2차 → 도메인 전문가 → 관리자

→ 1차 대응자가 30분 내 해결 못 하면 자동 에스컬레이션

③ 알림 피로 방지: 모든 알림은 조치 가능(Actionable)해야 한다

→ 행동 불필요한 알림은 즉시 제거 또는 레벨 다운

④ 온콜 보상: 야간/주말 온콜에는 명확한 보상 정책

→ 대체 휴무 or 수당

⑤ 사후 검토(Postmortem): 모든 P1 인시던트는 48시간 내 작성

→ 비난 없는 (Blameless) 문화

인시던트 대응 플로우

포스트모템 템플릿

# 인시던트 포스트모템: [파이프라인명] [날짜]

## 요약

- 심각도: P1 / P2 / P3

- 영향 기간: YYYY-MM-DD HH:MM ~ HH:MM (N시간 N분)

- 영향 범위: fct_orders, 매출 대시보드, X ML 모델

- 근본 원인: (한 줄 요약)

## 타임라인

| 시각 | 이벤트 |

|-------|--------------------------------------|

| 06:00 | 파이프라인 실패 알림 수신 |

| 06:05 | 온콜 엔지니어 확인 시작 |

| 06:20 | 소스 DB 스키마 변경 확인 |

| 06:45 | 파이프라인 수정 및 재실행 |

| 07:10 | 모든 다운스트림 정상화 확인 |

## 근본 원인 분석 (5-Why)

1. 왜 파이프라인이 실패했는가?

→ 소스 테이블에서 user_id 컬럼 타입이 INT → VARCHAR로 변경됨

2. 왜 이 변경을 사전에 감지하지 못했는가?

→ 소스 팀과의 데이터 계약에 컬럼 타입 변경 정책이 없었음

3. 왜 데이터 계약이 불완전했는가?

→ 계약 작성 시 Breaking Change 정의가 누락됨

## 재발 방지 액션 아이템

| 액션 | 담당자 | 기한 |

|-----------------------------------|--------|------------|

| 데이터 계약에 스키마 변경 정책 추가 | 김OO | 2026-04-26 |

| 소스 스키마 자동 감지 모니터링 추가 | 이OO | 2026-05-03 |

| 소스 팀과 Breaking Change 프로세스 합의 | 박OO | 2026-05-10 |

## 비난 없는 회고

- 이번 인시던트에서 잘 한 것: 빠른 영향 범위 파악, 소통

- 다음번에 개선할 것: 스키마 변경 모니터링 자동화

5. 런북(Runbook) 작성 가이드

런북은 "오전 3시에 처음 만나는 엔지니어도 문제를 해결할 수 있도록" 작성해야 한다. 좋은 런북은 알림이 발생했을 때 진단부터 해결까지의 전체 경로를 제시한다. 누가 온콜을 담당하든 일관된 인시던트 대응을 보장하고 새 팀원이 빠르게 효과적으로 대응할 수 있도록 돕는다.

런북 표준 구조

런북은 다음 5개 섹션으로 구성한다.

기본 정보 헤더

파이프라인: daily_orders_pipeline

오너: 데이터 플랫폼 팀 / data-platform@company.com

SLA: 매일 오전 7시 이전 갱신

연관 대시보드: 매출 대시보드, 재고 현황 대시보드

마지막 업데이트: 2026-04-19

알림 유형별 대응: "daily_orders_pipeline FAILED"

Step 1. Airflow UI에서 실패 태스크 확인 후 로그 조회.

Step 2. 소스 DB 연결 오류 여부 확인.

python scripts/check_source_connection.py --source orders_db

# 연결 실패 시: DBA 팀 온콜 에스컬레이션

Step 3. 스키마 변경 여부 확인.

-- Snowflake에서 소스 테이블 스키마 확인

SELECT column_name, data_type

FROM information_schema.columns

WHERE table_name = 'ORDERS'

ORDER BY ordinal_position;

-- 스키마 변경 발견 시: dbt 모델 수정 후 재실행

Step 4. 데이터 볼륨 이상 여부 확인.

SELECT COUNT(*), MAX(ordered_at)

FROM raw.orders

WHERE ordered_at::date = CURRENT_DATE - 1;

-- 0건이면 소스 시스템 문제 → 소스 팀 에스컬레이션

Step 5. 수동 재실행.

airflow dags trigger daily_orders_pipeline \

--conf '{"execution_date": "2026-04-19"}'

알림 유형별 대응: "fct_orders FRESHNESS EXCEEDED 4h"

- Airflow에서 마지막 성공 실행 시각 확인

- 대기 중인 실행 존재 여부 확인

- 업스트림 파이프라인(stg_orders) 상태 확인

dbt run --select fct_orders+ --target prod

dbt test --select fct_orders

에스컬레이션 연락처

| 상황 | 에스컬레이션 대상 | 연락 방법 |

|---|---|---|

| 소스 DB 장애 | DBA 팀 온콜 | PagerDuty 에스컬레이션 |

| Snowflake 장애 | Snowflake 지원 | support.snowflake.com |

| 비즈니스 크리티컬 데이터 누락 | 데이터 팀장 | 직접 전화 |

6. Write-Audit-Publish (WAP) 패턴

Write-Audit-Publish(WAP) 패턴은 데이터를 처리 후, 발행 전에 감사(검증)를 수행하여 소비자가 항상 검증된 데이터만 접근하게 보장하는 패턴이다.

# WAP 패턴 구현 예시 (Apache Iceberg Branch 활용)

import datetime

from pyiceberg.catalog import load_catalog

def write_audit_publish(

data_df,

table_name: str,

quality_checks: list

) -> bool:

"""WAP 패턴으로 안전한 데이터 발행"""

catalog = load_catalog("default")

table = catalog.load_table(table_name)

# WRITE: 감사 브랜치에 먼저 기록

audit_branch = f"audit-{datetime.date.today().isoformat()}"

table.manage_snapshots().create_branch(audit_branch).commit()

with table.transaction() as tx:

tx.set_branch(audit_branch)

tx.overwrite(data_df)

print(f"Write 완료: {audit_branch} 브랜치에 {len(data_df):,}행 기록")

# AUDIT: 품질 검사 실행

all_passed = True

for check in quality_checks:

result = check(table.scan(branch=audit_branch).to_pandas())

if not result.passed:

print(f"감사 실패: {check.__name__} — {result.message}")

all_passed = False

if not all_passed:

table.manage_snapshots().remove_branch(audit_branch).commit()

send_alert(f"WAP 감사 실패: {table_name}")

return False

# PUBLISH: 메인 브랜치에 원자적으로 병합

table.manage_snapshots().fast_forward(

branch="main",

to=audit_branch

).commit()

print(f"Publish 완료: {table_name} 메인 브랜치 업데이트")

return True

7. 데이터 엔지니어 커리어 패스 & 역량 로드맵

데이터 엔지니어 커리어 레벨

주니어 (0-2년)

- 핵심 목표: SQL, Python, 클라우드 기초 습득

- 기술 스택: Python, SQL, pandas, dbt 기초, 단일 클라우드 입문

- 업무: 기존 파이프라인 유지·보수, 간단한 dbt 모델 추가

- 연봉 (미국 기준): $90,000 - $110,000

- 성장 신호: "이 테이블이 왜 이렇게 됐지?" 질문에 스스로 답할 수 있게 됨

미드레벨 (2-5년)

- 핵심 목표: 독립적인 파이프라인 설계·구현·운영

- 기술 스택: Spark/Flink, Kafka, Terraform, Airflow, 클라우드 전문화

- 업무: 복잡한 파이프라인 독립 설계, 온콜 주도, 주니어 멘토링

- 연봉 (미국 기준): $120,000 - $145,000

- 성장 신호: 아키텍처 결정에 의견을 내고 방어할 수 있게 됨

시니어 (5-10년)

- 핵심 목표: 팀 전체 기술 방향 영향, 플랫폼 수준 설계

- 기술 스택: 폭넓은 기술 + 비즈니스 맥락 이해 + FinOps + 거버넌스

- 업무: 기술 표준 정의, 아키텍처 리뷰, 팀 역량 개발

- 연봉 (미국 기준): $150,000 - $175,000+

- 성장 신호: "내 결정이 내년 팀에 어떤 영향을 줄까?"를 먼저 묻게 됨

스태프/프린시플 (10년 이상)

- 핵심 목표: 조직 전체 데이터 전략 설계

- 역할: 데이터 아키텍트, 엔지니어링 매니저, CDO 트랙

- 연봉 (미국 기준): $180,000 - $220,000+

2026-2027 역량 로드맵 — 단계별

Phase 1 (0-3개월): 기초 다지기

✅ SQL 심화 (윈도우 함수, CTE, 최적화)

✅ Python 기초 (pandas, PEP8, 테스트 작성)

✅ Git 버전 관리

✅ 단일 클라우드 기초 (AWS or GCP or Azure)

✅ 첫 dbt 프로젝트 완성

Phase 2 (3-9개월): 파이프라인 전문화

✅ Apache Airflow DAG 작성 및 운영

✅ dbt 심화 (인크리멘탈 모델, 매크로, 패키지)

✅ 데이터 품질 검사 자동화 (Great Expectations or Soda)

✅ Docker + 컨테이너 기초

✅ Kafka 또는 Kinesis 스트리밍 기초

Phase 3 (9-18개월): 아키텍처 역량

✅ Apache Spark / PySpark 실전 활용

✅ Lakehouse 아키텍처 (Iceberg + Delta)

✅ Terraform IaC 실전

✅ 클라우드 데이터 플랫폼 비용 최적화

✅ 데이터 계약 & 거버넌스 구현

Phase 4 (18개월 이상): 전문화 & 리더십

[선택 트랙 A: AI/ML 전문화]

✅ Feature Store 설계 (Feast/Tecton)

✅ MLOps 파이프라인 (MLflow + Kubeflow)

✅ RAG 파이프라인 구축

✅ LLM 파인튜닝 데이터 처리

[선택 트랙 B: 플랫폼 엔지니어링 전문화]

✅ Kubernetes 운영 심화

✅ 데이터 플랫폼 SRE 실천

✅ FinOps 리더십

✅ 멀티클라우드 아키텍처

추천 학습 리소스 & 자격증

| 분야 | 추천 자료 |

|---|---|

| SQL | Mode Analytics SQL Tutorial, Advanced SQL for Data Scientists |

| dbt | dbt Learn (공식), dbt Fundamentals Certification |

| AWS | AWS Certified Data Engineer – Associate (DEA-C01) |

| GCP | Google Professional Data Engineer |

| Spark | Databricks Certified Associate Developer for Apache Spark |

| Kafka | Confluent Certified Developer for Apache Kafka |

| 커뮤니티 | dbt Slack, Data Engineering Weekly, Seattle Data Guy (YouTube) |

8. 2026-2028 미래 전망

확실한 변화 3가지

① AI와 데이터 엔지니어링의 경계 소멸

데이터 엔지니어링과 ML 엔지니어링의 구분이 점점 희미해진다. 피처 파이프라인, RAG 인프라, 에이전틱 파이프라인을 모두 담당하는 "AI-Native 데이터 엔지니어"가 표준이 된다. 데이터 아키텍처와 AI 모델 배포 모두에 능통한 MLOps 엔지니어들이 높은 수요를 받고 있다. 조직들은 신뢰할 수 있는 AI를 위해서는 그 아래에 견고한 데이터 엔지니어링이 반드시 있어야 한다는 것을 깨닫고 있다.

② 에이전틱 자동화의 심화

2027년까지 대부분의 루틴 파이프라인 유지보수는 AI 에이전트가 처리할 것이다. 데이터 엔지니어의 역할은 에이전트를 감독하고, 전략을 결정하며, 에이전트가 해결할 수 없는 복잡한 문제를 다루는 방향으로 이동한다.

③ 데이터 제품(Data Product) 중심 운영 확산

파이프라인 단위가 아닌 데이터 제품 단위로 팀을 구성하고 SLA를 관리하는 방식이 대기업을 중심으로 표준화된다. 각 데이터 제품은 명확한 소비자, 품질 SLA, 버전 관리, 문서를 갖춘다.

데이터 엔지니어에게 변하지 않는 것

도구는 바뀌지만, 본질은 바뀌지 않는다.

2026년이나 2030년이나 변하지 않는 가치:

1. 데이터 신뢰성 — "이 숫자를 믿을 수 있는가?"

2. 비즈니스 이해 — "이 데이터로 무엇을 결정할 것인가?"

3. 단순함 — "필요한 만큼만 복잡하게"

4. 소유 의식 — "내 파이프라인이 망가지면 내가 가장 먼저 안다"

5. 학습 민첩성 — "새 도구를 두려워하지 않고, 근본 원리로 이해한다"

9. 플레이북 전체 요약 — 내 팀을 위한 우선순위 결정법

7개 파트의 내용을 다 적용하려 하면 오히려 아무것도 못 한다. 팀 현황을 진단하고, 가장 임팩트 큰 것부터 시작하라.

30분 팀 진단 체크리스트

현재 가장 고통스러운 문제가 무엇인가?

□ "데이터가 틀렸어요"를 자주 듣는다

→ Part 4 (데이터 품질 & 거버넌스) 우선

→ 시작점: dbt test 추가, 데이터 계약 1개 작성

□ 파이프라인이 자주 깨지고 수습에 시간이 많이 든다

→ Part 3 (파이프라인 신뢰성) 우선

→ 시작점: 멱등성 확보, 알림 설정, 런북 1개 작성

□ 클라우드 비용이 예상보다 많이 나온다

→ Part 5 (FinOps) 우선

→ 시작점: 태깅 표준화, Snowflake auto-suspend, S3 수명주기 정책

□ ML 모델이 프로덕션에 가지 못한다

→ Part 6 (MLOps) 우선

→ 시작점: MLflow 실험 추적, Feature Store PoC

□ "누가 이 데이터 소유해요?"가 명확하지 않다

→ Part 4 (거버넌스) 우선

→ 시작점: 데이터 오너 RACI 매트릭스, 데이터 카탈로그 파일럿

□ 인프라를 수동으로 만들고 있다

→ Part 5 (IaC) 우선

→ 시작점: 핵심 리소스 3개 Terraform으로 코드화

성숙도별 우선순위 로드맵

초기 (0-6개월): 기반 구축

1. Git으로 모든 파이프라인 코드 버전 관리

2. Airflow 또는 Prefect 오케스트레이터 도입

3. dbt로 변환 레이어 코드화 시작

4. 주요 테이블 3개에 SLA 정의

5. 온콜 로테이션 시작 (팀 2명 이상)

성장 (6-18개월): 품질 내재화

1. 데이터 계약 핵심 테이블 10개에 적용

2. CI/CD 파이프라인 자동화

3. 데이터 카탈로그 파일럿

4. IaC 핵심 인프라 코드화

5. FinOps 대시보드 구축

성숙 (18개월 이상): 최적화 & 확장

1. DataGovOps 완전 자동화

2. AI/ML 데이터 인프라 구축

3. 에이전틱 셀프힐링 파이프라인 실험

4. Data Mesh 도입 검토

5. 전사 데이터 리터러시 프로그램

마치며 — 플레이북을 마무리하며

7개 파트에 걸친 긴 여정이었다.

Part 1에서 2026년 데이터 엔지니어링의 지형을 조망했고, Part 2-3에서 아키텍처와 파이프라인 구축의 기술을 깊이 다뤘다. Part 4에서 데이터를 신뢰할 수 있게 만드는 품질과 거버넌스를, Part 5에서 클라우드 인프라와 비용의 현실을 직시했다. Part 6에서 AI와의 융합을, 그리고 이 마지막 파트에서 이 모든 것을 사람과 팀이 지속 가능하게 운영하는 방법을 다뤘다.

플레이북 전체를 관통하는 단 하나의 메시지가 있다면 이것이다:

"기술보다 신뢰가 먼저다. 도구보다 원칙이 먼저다. 빠름보다 올바름이 먼저다."

빠르게 만든 파이프라인은 빠르게 망가진다. 신뢰를 쌓는 데는 시간이 걸리지만, 한번 쌓이면 팀 전체의 속도를 높인다. 데이터가 신뢰받는 순간, 조직의 모든 결정이 달라진다.

세계경제포럼(WEF)의 2025 미래직업 보고서는 빅데이터 전문가를 기술 분야에서 가장 빠르게 성장하는 직업으로 꼽았다. 2025년부터 2030년까지 100% 이상의 성장이 예측된다. 이 역할을 선택했다면, 당신은 옳은 곳에 있다.

이제 플레이북을 닫고, 코드 에디터를 열어라.

참고 자료

| 파트 | 주요 참고 자료 |

|---|---|

| Part 1-2 | Binariks, KDnuggets, Monte Carlo Data, Databricks |

| Part 3 | dbt Labs, AWS, ZenML, Kai Waehner |

| Part 4 | Alation, Atlan, OvalEdge, dbt Labs, Acceldata |

| Part 5 | Opsio, CloudZero, calmops.com |

| Part 6 | MLflow, Evidently AI, KDnuggets, Qlik, Databricks |

| Part 7 | lakeFS — WAP Pattern, dbt Labs Blog, Monte Carlo Data Blog, WEF Future of Jobs 2025 |