Data Engineering 플레이북 — Part 6: AI-Native 데이터 엔지니어링 (Feature Store, MLOps, RAG)

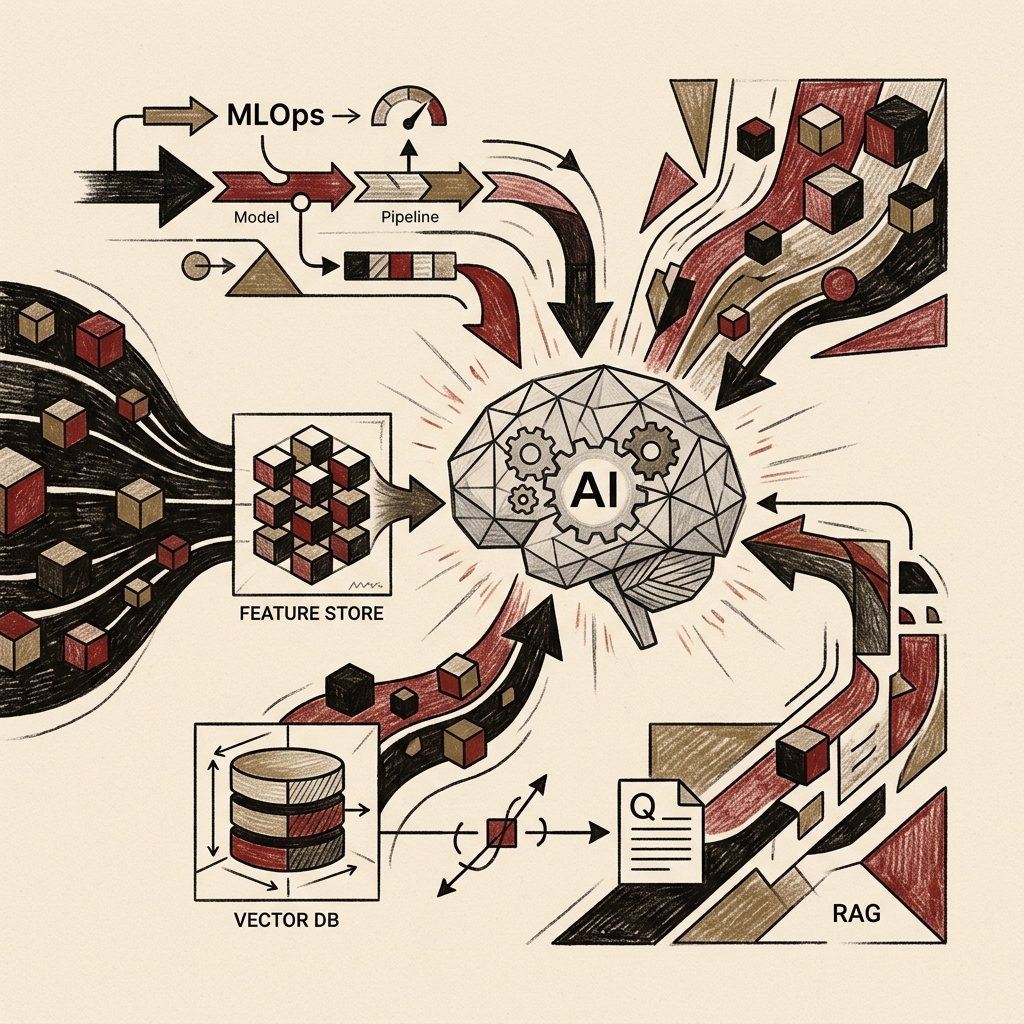

ML 프로젝트의 85% 이상이 프로덕션 미도달이라는 현실에서, 2026년 데이터 엔지니어의 핵심 역할은 Feature Store로 학습-서빙 스큐를 제거하고, MLOps로 모델 생명주기를 자동화하며, RAG 파이프라인으로 LLM에 실시간 컨텍스트를 공급하는 것이다. Point-in-Time 조인 구현부터 MLflow 실험 추적, 벡터 DB 선택 전략, 에이전틱 파이프라인 가드레일 설계까지 AI 인프라 전 영역을 실전 코드와 함께 다룬다.

시리즈 구성

- Part 1 — 개요 & 2026 핵심 트렌드 (완료)

- Part 2 — 데이터 아키텍처 설계 (완료)

- Part 3 — 데이터 파이프라인 구축 실전 가이드 (완료)

- Part 4 — 데이터 품질 & 거버넌스 심층 가이드 (완료)

- Part 5 — 클라우드 & 인프라 심층 가이드 (FinOps, IaC) (완료)

- Part 6 — AI-Native 데이터 엔지니어링 (Feature Store, MLOps, RAG) (현재 편)

- Part 7 — DataOps & 팀 운영 플레이북

목차

- 2026년, 데이터 엔지니어링이 AI 인프라가 되다

- Feature Store — ML의 데이터 공급 인프라

- MLOps — 모델 생명주기 자동화

- LLM을 위한 데이터 파이프라인

- RAG 파이프라인 설계 실전

- 벡터 데이터베이스 선택 가이드

- 에이전틱(Agentic) 데이터 파이프라인

- AI Copilot로 데이터 엔지니어링 가속화

- AI 데이터 파이프라인 거버넌스

- 실전 체크리스트

1. 2026년, 데이터 엔지니어링이 AI 인프라가 되다

2026년을 기점으로 데이터 엔지니어링의 역할은 근본적으로 확장됐다. 데이터를 옮기고 변환하는 것에서 시작해, 이제는 AI 시스템 전체가 작동하는 기반 인프라를 설계하고 운영하는 역할로 격상됐다.

Gartner의 2025년 AI 보고서에 따르면 ML 프로젝트의 85% 이상이 프로덕션에 도달하지 못하고, 프로덕션에 도달한 것 중 40% 미만이 12개월 이상 비즈니스 가치를 유지한다. 그 실패의 핵심 원인은 모델 자체가 아니라 데이터 인프라의 부재다.

데이터 엔지니어가 담당해야 할 AI 인프라의 핵심 컴포넌트는 다음과 같다.

| 컴포넌트 | 역할 |

|---|---|

| Feature Store | 학습·서빙 피처의 단일 진실 공급원 |

| 데이터 버전 관리 | 모델 재현성을 위한 데이터셋 버전 추적 |

| RAG 파이프라인 | LLM에 실시간 컨텍스트를 공급하는 인프라 |

| 벡터 데이터베이스 | 임베딩 저장 및 의미 기반 검색 |

| 모델 피처 서빙 | 밀리초 단위 실시간 피처 제공 |

| ML 파이프라인 오케스트레이션 | 학습·평가·배포 자동화 |

| 모델 모니터링 | 데이터 드리프트 탐지, 성능 저하 알림 |

2. Feature Store

Feature Store란?

Feature Store는 ML 피처(Feature)를 중앙에서 저장·관리·서빙하는 시스템이다. 피처란 ML 모델이 예측에 사용하는 입력 변수다 — 예를 들어 "최근 30일 구매 횟수", "사용자 평균 세션 시간" 같은 값들이다.

Feature Store가 없을 때 발생하는 문제:

문제 1: 학습-서빙 스큐 (Training-Serving Skew)

학습 시: user_age = (현재 날짜 - 생년월일) / 365

서빙 시: user_age = raw 데이터베이스 age 컬럼 (정수)

→ 같은 "나이"를 다르게 계산 → 모델 성능 저하

문제 2: 피처 재발명 (Feature Redundancy)

팀 A: 사용자 평균 구매 금액 계산 (Spark 잡)

팀 B: 동일한 피처 또 계산 (다른 SQL)

→ 중복 컴퓨팅 비용 + 값이 달라질 위험

문제 3: 데이터 누수 (Data Leakage)

미래 데이터가 학습에 포함되어 모델이 과적합

→ Feature Store의 Point-in-Time 조인이 이를 방지

Feature Store 아키텍처

Point-in-Time 조인 — 데이터 누수 방지

Feature Store의 핵심 기능. 모델 학습 시 각 학습 레코드의 "그 시점"에 존재했던 피처 값만 사용한다.

# Feast를 사용한 Point-in-Time 조인 예시

from feast import FeatureStore

import pandas as pd

store = FeatureStore(repo_path=".")

# 학습 데이터: 각 주문이 발생한 시점의 고객 피처를 조회 (미래 데이터 포함 방지)

training_df = pd.DataFrame({

"customer_id": ["c001", "c002", "c003"],

"event_timestamp": pd.to_datetime([

"2026-01-15 10:00:00",

"2026-02-20 14:30:00",

"2026-03-05 09:15:00",

]),

"label": [1, 0, 1] # 이탈 여부

})

# Feast가 각 timestamp 기준으로 그 시점의 피처 값을 자동 조회

feature_vector = store.get_historical_features(

entity_df=training_df,

features=[

"customer_stats:purchase_count_30d", # 최근 30일 구매 수

"customer_stats:avg_order_value", # 평균 주문 금액

"customer_stats:days_since_last_order", # 마지막 주문 이후 일수

"customer_stats:total_lifetime_value", # 총 생애 가치

]

).to_df()

print(feature_vector)

# customer_id | event_timestamp | purchase_count_30d | avg_order_value | ...

# c001 | 2026-01-15 | 3 | 45.20 | ...

실시간 피처 서빙

# 온라인 추론 시 피처 실시간 조회

from feast import FeatureStore

store = FeatureStore(repo_path=".")

def predict_churn(customer_id: str) -> float:

"""실시간 이탈 예측 — Feature Store에서 최신 피처 조회"""

# 온라인 스토어(Redis)에서 밀리초 단위로 피처 조회

feature_vector = store.get_online_features(

features=[

"customer_stats:purchase_count_30d",

"customer_stats:avg_order_value",

"customer_stats:days_since_last_order",

],

entity_rows=[{"customer_id": customer_id}]

).to_dict()

# 모델 추론

prediction = churn_model.predict([

feature_vector["purchase_count_30d"][0],

feature_vector["avg_order_value"][0],

feature_vector["days_since_last_order"][0],

])

return float(prediction[0])

Feature Store 도구 비교

| 도구 | 특징 | 적합 상황 | 오픈소스 |

|---|---|---|---|

| Feast | 경량, 다양한 스토어 지원, 커뮤니티 활발 | 팀 자체 인프라 구축 | ✅ |

| Tecton | 기업용, 실시간 변환, Databricks 통합 | 엔터프라이즈, 강력한 실시간 요건 | ❌ |

| Databricks Feature Store | Lakehouse와 완전 통합, Unity Catalog 연동 | Databricks 환경 사용 시 | 부분 |

| Vertex AI Feature Store | GCP 관리형, Vertex AI와 깊은 통합 | GCP 중심 환경 | ❌ |

| Hopsworks | 오픈소스 풀스택, 실시간+배치 통합 | 자체 호스팅 원하는 중대형 팀 | ✅ |

3. MLOps

MLOps 7단계 파이프라인

MLOps는 ML 개발(Dev)과 운영(Ops)을 통합하여 ML 시스템을 신뢰성 있게, 반복 가능하게 배포·운영하는 엔지니어링 규율이다. Gartner의 통계에 따르면 성숙한 MLOps 실천을 갖춘 조직은 그렇지 않은 조직보다 ML 피처를 4배 빠르게 출시하고, 모델 드리프트를 28배 빠르게 탐지한다.

MLflow 실전 — 실험 추적

# MLflow로 실험 추적 — 모든 학습 실행을 기록

import mlflow

import mlflow.sklearn

from sklearn.ensemble import RandomForestClassifier

from sklearn.metrics import accuracy_score, roc_auc_score

mlflow.set_experiment("churn-prediction-v2")

with mlflow.start_run(run_name="rf-baseline"):

# ① 하이퍼파라미터 기록

params = {

"n_estimators": 200,

"max_depth": 8,

"min_samples_split": 10,

"class_weight": "balanced",

}

mlflow.log_params(params)

# ② 데이터 버전 기록 (재현성)

mlflow.log_param("dataset_version", "v2026-04-19")

mlflow.log_param("feature_store_snapshot", "20260419-0600")

# ③ 모델 학습

model = RandomForestClassifier(**params, random_state=42)

model.fit(X_train, y_train)

# ④ 성능 지표 기록

y_pred = model.predict(X_test)

y_prob = model.predict_proba(X_test)[:, 1]

metrics = {

"accuracy": accuracy_score(y_test, y_pred),

"roc_auc": roc_auc_score(y_test, y_prob),

"precision": precision_score(y_test, y_pred),

"recall": recall_score(y_test, y_pred),

}

mlflow.log_metrics(metrics)

# ⑤ 모델 아티팩트 저장 (입력/출력 스키마 명시로 거버넌스 확보)

mlflow.sklearn.log_model(

model,

artifact_path="churn-model",

registered_model_name="CustomerChurnPredictor",

signature=mlflow.models.infer_signature(X_train, y_pred),

)

print(f"ROC-AUC: {metrics['roc_auc']:.4f}")

모델 레지스트리 — 스테이지 관리

# MLflow 모델 레지스트리: Staging → Production 프로모션

from mlflow.tracking import MlflowClient

client = MlflowClient()

def promote_to_production(model_name: str, run_id: str, min_auc: float = 0.85):

"""성능 기준 충족 시 모델을 Staging → Production으로 승격"""

run = client.get_run(run_id)

auc = run.data.metrics.get("roc_auc", 0)

if auc < min_auc:

raise ValueError(f"ROC-AUC {auc:.4f} < 기준 {min_auc}. 프로모션 거부.")

# 현재 Production 모델 Archived로 전환

current_prod = client.get_latest_versions(model_name, stages=["Production"])

for version in current_prod:

client.transition_model_version_stage(

name=model_name,

version=version.version,

stage="Archived",

archive_existing_versions=False

)

# 새 버전 Production으로 승격

latest = client.get_latest_versions(model_name, stages=["Staging"])

client.transition_model_version_stage(

name=model_name,

version=latest[0].version,

stage="Production",

archive_existing_versions=True

)

print(f"✅ 모델 v{latest[0].version} → Production 승격 완료 (AUC: {auc:.4f})")

모델 모니터링 — 드리프트 탐지

# Evidently AI를 사용한 데이터/모델 드리프트 모니터링

from evidently.report import Report

from evidently.metric_preset import DataDriftPreset, TargetDriftPreset

from evidently.metrics import *

def monitor_model_drift(reference_df, current_df, output_path: str):

"""주간 드리프트 리포트 생성 — Airflow에서 스케줄 실행"""

report = Report(metrics=[

DataDriftPreset(), # 피처 분포 변화 탐지

TargetDriftPreset(), # 예측값/실제값 분포 변화

DataQualityPreset(), # 데이터 품질 점수

ClassificationPreset(), # 분류 모델 성능 지표

])

report.run(reference_data=reference_df, current_data=current_df)

report.save_html(output_path)

result = report.as_dict()

drift_detected = result["metrics"][0]["result"]["dataset_drift"]

if drift_detected:

trigger_retraining_pipeline()

send_slack_alert(

channel="#ml-alerts",

message="⚠️ 데이터 드리프트 탐지 — 모델 재학습 파이프라인 시작됨"

)

return drift_detected

MLOps 핵심 도구 스택 2026

| 영역 | 도구 |

|---|---|

| 데이터 버전 관리 | DVC, lakeFS, Delta Lake Time Travel |

| 실험 추적 | MLflow 3 (GenAI 기능 포함), Weights & Biases |

| 피처 스토어 | Feast, Tecton, Databricks Feature Store |

| 모델 레지스트리 | MLflow Registry, Hugging Face Hub |

| ML 파이프라인 | Kubeflow, Metaflow, Vertex AI Pipelines |

| 모델 서빙 | BentoML, Ray Serve, Seldon, FastAPI |

| 모니터링 | Evidently AI, WhyLabs, Arize AI |

4. LLM을 위한 데이터 파이프라인

LLM 시대의 데이터 엔지니어링

LLM의 등장으로 데이터 엔지니어링의 책임 범위가 구조화 데이터에서 비구조화 데이터를 포함한 전체로 확장됐다. 텍스트, PDF, 이미지, 오디오, 비디오가 모두 처리 대상이다.

"AI가 내놓는 결과물의 품질은 그것이 학습하거나 참조하는 데이터의 품질에 종속된다. 좋은 데이터 파이프라인 없이는 좋은 AI가 없다."

LLM 사전학습 데이터 파이프라인

- 원시 데이터 수집 — 웹 크롤링 / 공개 데이터셋

- 중복 제거 — MinHash / SimHash로 동일·유사 문서 제거

- 품질 필터링 — 짧은 문서 제거, 스팸·광고·성인 콘텐츠 필터링, 언어 감지

- 민감 정보 제거 — 이메일, 전화번호, 주민번호 마스킹 (PII 제거)

- 토큰화 — BPE / SentencePiece로 텍스트 → 토큰 변환

- 데이터셋 버전 관리 — DVC / lakeFS

- 학습 데이터 저장 — S3 / GCS (Parquet / JSONL)

파인튜닝 데이터 파이프라인

# 파인튜닝용 고품질 데이터셋 구축 파이프라인

import json

from dataclasses import dataclass

from typing import Optional

@dataclass

class FineTuningExample:

"""파인튜닝 학습 데이터 포맷 (Instruction Fine-tuning)"""

system: str

instruction: str

input: Optional[str]

output: str

source: str # 데이터 출처 (추적성)

quality_score: float # 품질 점수 (0.0-1.0)

def build_finetuning_dataset(raw_examples: list) -> list:

"""원시 예시 → 파인튜닝 데이터셋 변환 파이프라인"""

pipeline = [

filter_low_quality, # 품질 점수 < 0.7 제거

remove_pii, # PII 마스킹

deduplicate, # 유사 예시 제거

validate_format, # 포맷 검증

compute_quality_score, # 품질 재점수화

]

processed = raw_examples

for step in pipeline:

before = len(processed)

processed = [step(ex) for ex in processed if ex is not None]

processed = [ex for ex in processed if ex is not None]

after = len(processed)

print(f"[{step.__name__}] {before} → {after} ({before-after} 제거)")

return processed

def filter_low_quality(example: dict) -> Optional[dict]:

if len(example.get("output", "")) < 50:

return None

if example.get("quality_score", 0) < 0.7:

return None

return example

def remove_pii(example: dict) -> dict:

"""개인정보 마스킹"""

import re

pii_patterns = {

r'\b[A-Za-z0-9._%+-]+@[A-Za-z0-9.-]+\.[A-Z|a-z]{2,}\b': '[EMAIL]',

r'\b\d{3}-\d{4}-\d{4}\b': '[PHONE]',

r'\b\d{6}-\d{7}\b': '[ID_NUMBER]',

}

for field in ["instruction", "input", "output"]:

if field in example and example[field]:

for pattern, replacement in pii_patterns.items():

example[field] = re.sub(pattern, replacement, example[field])

return example

5. RAG 파이프라인 설계 실전

RAG(Retrieval-Augmented Generation)란?

RAG는 LLM이 답변을 생성할 때 모델 가중치에만 의존하는 대신, 외부 지식 베이스에서 실시간으로 관련 정보를 검색해 컨텍스트로 활용하는 패턴이다.

왜 RAG인가? LLM을 처음부터 파인튜닝하는 것과 비교하면, RAG는 지식을 업데이트할 때 모델 재학습이 필요 없고, 특정 문서를 인용 출처로 제시할 수 있어 사실 확인(Grounding)이 가능하며, 비용이 극적으로 낮다.

RAG 파이프라인 — 2단계 구조

프로덕션 RAG 파이프라인 구현

# production_rag.py

# 엔터프라이즈 수준 RAG 파이프라인 구현

from langchain_openai import OpenAIEmbeddings, ChatOpenAI

from langchain_community.vectorstores import Weaviate

from langchain.text_splitter import RecursiveCharacterTextSplitter

from langchain_core.prompts import ChatPromptTemplate

from langchain_core.runnables import RunnablePassthrough

import weaviate

# --- 1단계: 인덱싱 파이프라인 ---

class DocumentIndexer:

def __init__(self, weaviate_client, embedding_model):

self.client = weaviate_client

self.embeddings = embedding_model

self.splitter = RecursiveCharacterTextSplitter(

chunk_size=800, # 청크 크기: LLM 컨텍스트 vs 검색 정밀도 균형

chunk_overlap=100, # 청크 간 겹침: 경계 정보 손실 방지

separators=["\n\n", "\n", ".", " "],

)

def index_documents(self, documents: list, collection_name: str):

"""문서를 청킹 → 임베딩 → 벡터 DB 저장"""

chunks = []

for doc in documents:

splits = self.splitter.split_text(doc["content"])

for i, chunk in enumerate(splits):

chunks.append({

"content": chunk,

"source": doc["source"],

"doc_id": doc["id"],

"chunk_index": i,

"updated_at": doc.get("updated_at"),

})

# 증분 업데이트: 이미 인덱싱된 문서는 건너뜀

new_chunks = self._filter_new_chunks(chunks, collection_name)

if new_chunks:

Weaviate.from_texts(

texts=[c["content"] for c in new_chunks],

embedding=self.embeddings,

client=self.client,

index_name=collection_name,

metadatas=[{k: v for k, v in c.items() if k != "content"}

for c in new_chunks]

)

print(f"✅ {len(new_chunks)}개 청크 인덱싱 완료")

# --- 2단계: 검색 & 생성 파이프라인 ---

class RAGChain:

def __init__(self, vectorstore, llm):

self.vectorstore = vectorstore

self.llm = llm

self.retriever = vectorstore.as_retriever(

search_type="hybrid",

search_kwargs={

"k": 6, # 검색할 청크 수

"alpha": 0.7, # 0=키워드, 1=벡터 (0.7 = 벡터 우세)

}

)

def build_chain(self):

"""RAG 체인 구성"""

prompt = ChatPromptTemplate.from_messages([

("system", """당신은 회사 내부 데이터 분석 전문가입니다.

반드시 아래 제공된 컨텍스트만을 기반으로 답변하세요.

컨텍스트에 없는 내용은 "해당 정보를 찾을 수 없습니다"라고 답변하세요.

답변 시 근거가 된 문서의 출처를 명시하세요.

컨텍스트:

{context}"""),

("human", "{question}")

])

return (

{"context": self.retriever | self._format_docs,

"question": RunnablePassthrough()}

| prompt

| self.llm

)

def _format_docs(self, docs):

formatted = []

for doc in docs:

source = doc.metadata.get("source", "Unknown")

formatted.append(f"[출처: {source}]\n{doc.page_content}")

return "\n\n---\n\n".join(formatted)

def query(self, question: str) -> dict:

chain = self.build_chain()

retrieved_docs = self.retriever.invoke(question)

response = chain.invoke(question)

return {

"answer": response.content,

"sources": [doc.metadata.get("source") for doc in retrieved_docs],

"retrieved_chunks": len(retrieved_docs),

}

청킹 전략 선택 가이드

문서 유형별 최적 청킹 전략:

① 서술형 문서 (위키, 보고서)

→ RecursiveCharacterTextSplitter

→ chunk_size=800-1,200, overlap=100-150

→ 단락 경계를 존중

② 구조화 문서 (FAQ, 매뉴얼)

→ 구조 기반 분할 (섹션/헤더 단위)

→ Markdown Header Text Splitter

③ 코드 문서

→ 함수/클래스 단위로 분할

→ Code Splitter (언어 인식)

④ 표 포함 문서

→ 표를 별도 청크로 분리

→ 표 전체를 하나의 청크로 유지

청크 크기 최적화 원칙:

너무 작으면: 컨텍스트 단절 → 관련성 낮은 검색 결과

너무 크면: 노이즈 증가 → LLM 컨텍스트 창 낭비

실무 권고: 500-1,000 토큰 (문서 유형에 따라 조정)

6. 벡터 데이터베이스 선택 가이드

벡터 DB란?

벡터 데이터베이스는 임베딩(고차원 부동소수점 벡터)을 저장하고, **의미론적 유사도 기반 검색(ANN, Approximate Nearest Neighbor)**을 밀리초 단위로 수행하는 특화 데이터베이스다.

2026년 벡터 DB 비교

| DB | 아키텍처 | 스케일 | 관리형 | 강점 | 적합 상황 |

|---|---|---|---|---|---|

| pgvector | PostgreSQL 확장 | 약 5,000만 벡터 | AWS RDS, Supabase | SQL 통합, 친숙한 운영 | 이미 PostgreSQL 사용, 1천만 이하 벡터 |

| Pinecone | 관리형 전용 클라우드 | 수억 벡터 | ✅ 완전 관리형 | 운영 부담 제로, 빠른 시작 | 인프라 투자 없이 즉시 시작 |

| Weaviate | 오픈소스 분산형 | 수억 벡터 | ✅ (Weaviate Cloud) | 내장 임베딩 모듈, GraphQL | 멀티모달, 자체 호스팅 유연성 |

| Qdrant | Rust 기반 오픈소스 | 수억 벡터 | ✅ (Qdrant Cloud) | 고성능, 필터링 우수 | 고성능 요건, K8s 운영 가능 |

| Milvus | 오픈소스 분산형 | 수십억 벡터 | ✅ (Zilliz) | 초대규모 확장 | 수십억 벡터 이상 |

| Chroma | 경량 로컬 | 수백만 벡터 | ❌ | 설치 간단, 빠른 프로토타이핑 | 개발/테스트, PoC |

벡터 DB 선택 의사결정

pgvector 실전 사용 예시

-- pgvector 설치 및 사용

CREATE EXTENSION IF NOT EXISTS vector;

-- 임베딩 테이블 생성 (1536차원 = OpenAI text-embedding-3-small)

CREATE TABLE document_embeddings (

id BIGSERIAL PRIMARY KEY,

content TEXT NOT NULL,

embedding VECTOR(1536),

source TEXT,

doc_id TEXT,

created_at TIMESTAMP DEFAULT NOW(),

department TEXT,

language TEXT DEFAULT 'ko'

);

-- HNSW 인덱스 생성 (ANN 검색을 위한 핵심!)

-- m: 연결 수 (정확도 vs 메모리), ef_construction: 인덱스 품질

CREATE INDEX ON document_embeddings

USING hnsw (embedding vector_cosine_ops)

WITH (m = 16, ef_construction = 64);

-- 의미론적 유사도 검색

SELECT

content,

source,

1 - (embedding <=> $1::vector) AS similarity_score

FROM document_embeddings

WHERE department = '재무팀'

AND language = 'ko'

ORDER BY embedding <=> $1::vector

LIMIT 5;

-- 하이브리드 검색 (벡터 + 전문 검색 결합)

SELECT

content,

source,

(1 - (embedding <=> $1::vector)) * 0.7 +

ts_rank(to_tsvector('korean', content),

plainto_tsquery('korean', $2)) * 0.3

AS combined_score

FROM document_embeddings

WHERE to_tsvector('korean', content) @@ plainto_tsquery('korean', $2)

ORDER BY combined_score DESC

LIMIT 10;

7. 에이전틱(Agentic) 데이터 파이프라인

에이전틱 AI가 데이터 엔지니어링에 미치는 영향

2026년 가장 주목할 만한 변화 중 하나는 에이전틱 AI의 데이터 파이프라인 통합이다. 전통적인 파이프라인이 미리 정해진 스크립트를 실행했다면, 에이전틱 파이프라인은 상황을 인식하고 스스로 결정하며 행동한다.

2026년 3월, Databricks는 Genie Code를 출시했다. 이 에이전트는 파이프라인 구축, 장애 디버깅, 대시보드 배포, 프로덕션 시스템 유지보수 같은 복잡한 작업을 자율적으로 수행할 수 있다.

셀프힐링 파이프라인 패턴

# self_healing_pipeline.py

# AI 에이전트가 파이프라인 장애를 자율 진단하고 복구하는 패턴

import anthropic

import json

client = anthropic.Anthropic()

PIPELINE_TOOLS = [

{

"name": "get_pipeline_logs",

"description": "파이프라인 실행 로그를 조회합니다",

"input_schema": {

"type": "object",

"properties": {

"pipeline_id": {"type": "string"},

"lines": {"type": "integer", "default": 100}

},

"required": ["pipeline_id"]

}

},

{

"name": "check_data_quality",

"description": "데이터 품질 지표를 확인합니다",

"input_schema": {

"type": "object",

"properties": {

"table_name": {"type": "string"},

"date": {"type": "string"}

},

"required": ["table_name"]

}

},

{

"name": "restart_pipeline",

"description": "파이프라인을 재시작합니다. 원인 분석 후에만 사용하세요.",

"input_schema": {

"type": "object",

"properties": {

"pipeline_id": {"type": "string"},

"backfill_date": {"type": "string", "description": "백필 시작일"}

},

"required": ["pipeline_id"]

}

},

{

"name": "escalate_to_human",

"description": "복잡한 문제를 사람에게 에스컬레이션합니다",

"input_schema": {

"type": "object",

"properties": {

"issue_summary": {"type": "string"},

"severity": {"type": "string", "enum": ["low", "medium", "high", "critical"]}

},

"required": ["issue_summary", "severity"]

}

}

]

def diagnose_and_heal(pipeline_id: str, error_message: str):

"""에이전트가 파이프라인 장애를 자율 진단하고 복구 시도"""

messages = [

{

"role": "user",

"content": f"""파이프라인 '{pipeline_id}'에서 오류가 발생했습니다.

오류 메시지: {error_message}

다음 순서로 진단하세요:

1. 파이프라인 로그를 조회해 근본 원인을 파악하세요

2. 데이터 품질 문제인지 확인하세요

3. 자동 복구가 안전하다고 판단되면 재시작하세요

4. 복잡한 문제라면 사람에게 에스컬레이션하세요

모든 행동과 그 이유를 로그로 남기세요."""

}

]

# 에이전트 루프 — 문제가 해결되거나 에스컬레이션될 때까지 반복

max_iterations = 5

for iteration in range(max_iterations):

response = client.messages.create(

model="claude-sonnet-4-6",

max_tokens=2048,

tools=PIPELINE_TOOLS,

messages=messages

)

if response.stop_reason == "end_turn":

print(f"✅ 에이전트 진단 완료: {response.content[0].text}")

break

if response.stop_reason == "tool_use":

tool_results = []

for block in response.content:

if block.type == "tool_use":

print(f"🔧 에이전트 행동: {block.name}({block.input})")

result = execute_tool(block.name, block.input)

tool_results.append({

"type": "tool_result",

"tool_use_id": block.id,

"content": json.dumps(result)

})

if block.name == "escalate_to_human":

send_pagerduty_alert(block.input)

return

messages.append({"role": "assistant", "content": response.content})

messages.append({"role": "user", "content": tool_results})

에이전틱 파이프라인의 한계와 가드레일

에이전틱 시스템은 강력하지만, 모든 자율 행동에 대해 명확한 감사 추적과 인간 에스컬레이션 경로가 필수다.

에이전틱 파이프라인 거버넌스 원칙:

✅ 허용 (낮은 위험)

- 로그 조회, 상태 확인

- 알림 발송

- 재시도 횟수 내 재실행

⚠️ 조건부 허용 (중간 위험)

- 스케줄 변경

- 자동 백필 (범위 제한 필요)

- 쿼리 최적화 제안 (실행 전 사람 승인)

❌ 금지 (높은 위험 — 반드시 사람이 결정)

- 프로덕션 데이터 삭제

- 스키마 변경

- 접근 권한 변경

- 비용 임계값 초과 리소스 생성

8. AI Copilot로 데이터 엔지니어링 가속화

2026년 AI Copilot 현황

AI Copilot과 자율 워크플로우가 데이터 엔지니어링 툴킷의 표준 컴포넌트로 자리잡았다. 2026년 실제로 작동하는 AI 보조 도구의 강점 영역은 다음과 같다.

- AI 페어 프로그래밍 (GitHub Copilot, Snowflake Cortex Code): 개발 시간 30-40% 단축

- 자동화된 이상 탐지: AI 모델이 쿼리 실행 로그, 데이터 분포, 계보 그래프를 분석해 이상 징후 조기 탐지

- dbt Copilot: SQL 모델 자연어 생성, 최적화 제안, 문서 자동화

- Databricks Genie Code: 복잡한 파이프라인 구축, 디버깅, 배포까지 에이전트가 자율 수행

AI Copilot 실전 활용 패턴

-- 자연어 요청:

-- "주문 테이블에서 월별로, 국가별로 매출을 집계하는 dbt 모델 만들어줘.

-- 취소 주문은 제외하고, 전월 대비 성장률도 포함해줘."

-- AI가 생성한 dbt 모델: models/marts/fct_monthly_revenue_by_country.sql

with orders as (

select * from {{ ref('stg_orders') }}

where order_status != 'cancelled'

),

monthly_revenue as (

select

DATE_TRUNC('month', ordered_at) as month,

country,

SUM(order_amount_usd) as revenue,

COUNT(*) as order_count

from orders

group by 1, 2

),

with_growth as (

select

month,

country,

revenue,

order_count,

LAG(revenue) OVER (

PARTITION BY country

ORDER BY month

) as prev_month_revenue,

ROUND(

(revenue - LAG(revenue) OVER (

PARTITION BY country ORDER BY month

)) / NULLIF(LAG(revenue) OVER (

PARTITION BY country ORDER BY month

), 0) * 100, 2

) as mom_growth_pct

from monthly_revenue

)

select * from with_growth

AI 코파일럿 활용 시 주의사항

AI Copilot 결과물에 대한 검증 체크리스트:

□ 비즈니스 로직이 요구사항과 일치하는가?

□ JOIN 조건이 적절한가? (데이터 폭발/손실 위험)

□ NULL 처리가 올바른가?

□ 날짜/시간 처리에 타임존 이슈가 없는가?

□ GROUP BY 컬럼이 완전한가?

□ 윈도우 함수의 PARTITION BY, ORDER BY가 의도대로인가?

□ 인덱스/파티션을 활용하는 효율적인 쿼리인가?

원칙: AI는 초안을 작성하고, 사람이 검증하고 책임진다.

9. AI 데이터 파이프라인 거버넌스

AI 레디 데이터의 요건

AI 모델의 출력 품질은 학습·추론 데이터의 품질에 직결된다. AI 레디(AI-Ready) 데이터란 AI가 신뢰할 수 있는 결과를 내놓기 위해 갖춰야 할 데이터의 속성을 말한다.

AI-Ready 데이터 체크리스트:

① 완전성: 필수 필드가 모두 채워져 있는가?

→ NULL 비율 < 0.1% (학습 데이터 기준)

② 편향 없음: 특정 그룹에 편향된 샘플링이 없는가?

→ 인구통계, 지역, 시간대별 샘플 분포 검토

③ 레이블 품질: 분류 모델의 경우 레이블이 정확한가?

→ 인간 검수 + 교차 검증 필수

④ 시간 일관성: 학습 데이터와 서빙 데이터의 피처 분포가 유사한가?

→ 드리프트 모니터링으로 지속 감시

⑤ PII 제거: 개인식별정보가 학습 데이터에서 제거됐는가?

→ EU AI Act 컴플라이언스 요건

⑥ 데이터 계보: 학습 데이터의 출처와 변환 이력이 추적 가능한가?

→ 모델 감사(Audit) 및 규제 대응에 필수

모델 카드 (Model Card) — 데이터 엔지니어의 역할

# model_card.yaml

# 모델 배포 시 데이터 엔지니어가 작성해야 할 섹션

model_name: "CustomerChurnPredictor-v2.3"

training_data:

description: "2024-01 - 2026-03 구독 고객 구매 이력"

source: "gold.fct_customer_orders"

size:

rows: 2_450_000

positive_samples: 312_000

negative_samples: 2_138_000

class_balance: "1:6.8 (이탈:유지)"

data_version: "snapshot-2026-04-01"

limitations:

- "신규 가입 30일 미만 고객 제외"

- "B2B 고객 미포함 (별도 모델 필요)"

- "2020년 이전 이탈 패턴 미반영"

pii_handling:

fields_removed: ["customer_name", "email", "phone"]

fields_tokenized: ["customer_id"]

compliance: ["GDPR", "개인정보보호법"]

metrics:

overall:

roc_auc: 0.891

precision: 0.784

recall: 0.823

by_segment:

premium_customers:

roc_auc: 0.921

standard_customers:

roc_auc: 0.867

monitoring:

drift_threshold: 0.15

retraining_trigger: "주간 AUC < 0.85"

data_freshness_sla: "24시간"

10. 실전 체크리스트

Feature Store

- 학습용 오프라인 스토어와 서빙용 온라인 스토어가 분리되어 있는가?

- Point-in-Time 조인으로 데이터 누수가 방지되는가?

- 피처 정의가 코드로 버전 관리되고 있는가?

- 학습과 서빙에서 동일한 피처 변환 로직이 사용되는가?

- 피처 드리프트 모니터링이 설정됐는가?

MLOps

- 모든 실험이 MLflow 또는 W&B로 추적되고 있는가?

- 학습 데이터셋이 버전 관리(DVC/lakeFS)되고 있는가?

- 모델 레지스트리에 Staging → Production 프로모션 워크플로우가 있는가?

- 모델 배포 CI/CD 파이프라인이 자동화됐는가?

- 데이터 드리프트와 모델 성능 저하 모니터링이 작동하는가?

- 재학습 트리거 조건이 정의되어 있는가?

RAG 파이프라인

- 청킹 전략이 문서 유형에 맞게 최적화됐는가?

- 벡터 DB에 메타데이터 필터링이 구성됐는가?

- 하이브리드 검색(벡터 + 키워드)이 적용됐는가?

- 문서 업데이트 시 인덱스 증분 업데이트가 자동화됐는가?

- RAG 응답의 출처 인용 기능이 구현됐는가?

- 할루시네이션 방지를 위한 프롬프트 가이드라인이 있는가?

벡터 데이터베이스

- 예상 벡터 수와 QPS에 맞는 DB가 선택됐는가?

- HNSW 인덱스 파라미터가 정확도-성능 트레이드오프에 맞게 튜닝됐는가?

- 임베딩 모델 업그레이드 시 재인덱싱 계획이 있는가?

에이전틱 AI

- 에이전트가 취할 수 있는 행동 범위(허용/금지)가 명확히 정의됐는가?

- 모든 자율 행동이 감사 로그로 기록되는가?

- 인간 에스컬레이션 경로와 조건이 설정됐는가?

AI 데이터 거버넌스

- 학습 데이터에서 PII가 완전히 제거/마스킹됐는가?

- 모델 카드(Model Card)가 작성·관리되고 있는가?

- 학습 데이터 계보(Lineage)가 추적 가능한가?

- 데이터 편향 검사가 학습 파이프라인에 포함됐는가?

- EU AI Act 등 관련 규제 컴플라이언스가 검토됐는가?

마치며

2026년 데이터 엔지니어의 역할은 "파이프라인 배관공"에서 "AI 인프라 아키텍트"로 진화했다.

피처를 신뢰할 수 있게 공급하고, 모델의 생명주기를 자동화하고, LLM이 실시간 컨텍스트로 활용할 수 있는 RAG 인프라를 구축하고, 에이전틱 AI가 안전하게 작동할 수 있는 거버넌스 프레임워크를 설계하는 것 — 이 모든 것이 현대 데이터 엔지니어의 책임이다.

기술 자체보다 더 중요한 원칙이 있다: AI는 초안을 제시하고, 사람이 검증하며 책임진다. 자동화가 아무리 발전해도, 데이터의 신뢰성과 AI 결정의 공정성에 대한 궁극적 책임은 사람에게 있다.

플레이북의 마지막 파트에서는 이 모든 기술을 팀과 조직 안에서 지속 가능하게 운영하는 방법 — DataOps 문화와 팀 운영 플레이북 — 을 다룬다.

Part 7 예고: DataOps & 팀 운영 플레이북 (최종 파트)

- DataOps 문화 구축 — 파이프라인을 제품처럼

- 데이터 엔지니어링 팀 구조와 역할 설계

- 온콜(On-call) 운영과 런북(Runbook) 작성법

- 데이터 SLA/SLO/SLI 정의와 측정

- 데이터 팀의 커리어 패스와 역량 개발 로드맵

- 2026-2028 데이터 엔지니어링 미래 전망

작성 기준: 2026년 4월 | 참고: Databricks, MLflow, Gartner AI Report 2025, Evidently AI, Atlan, KDnuggets

참고 자료

이 글의 기술 주장과 운영 판단을 다시 확인할 때 참고할 수 있는 문서입니다.